《KAN: Kolmogorov-Arnold Networks》论文链接:https://arxiv.org/abs/2404.19756。

该模型实现了从“参数网络(节点)”的学习到“函数网络(节点性状)”的学习的转变。

- 优势是可解释性好,能够自动揭示数据的内在组合结构,有助于科学发现。

- 局限性是模型复杂度更高,比较难搭建和训练,和传统的神经网络模型优化算法不完全兼容。

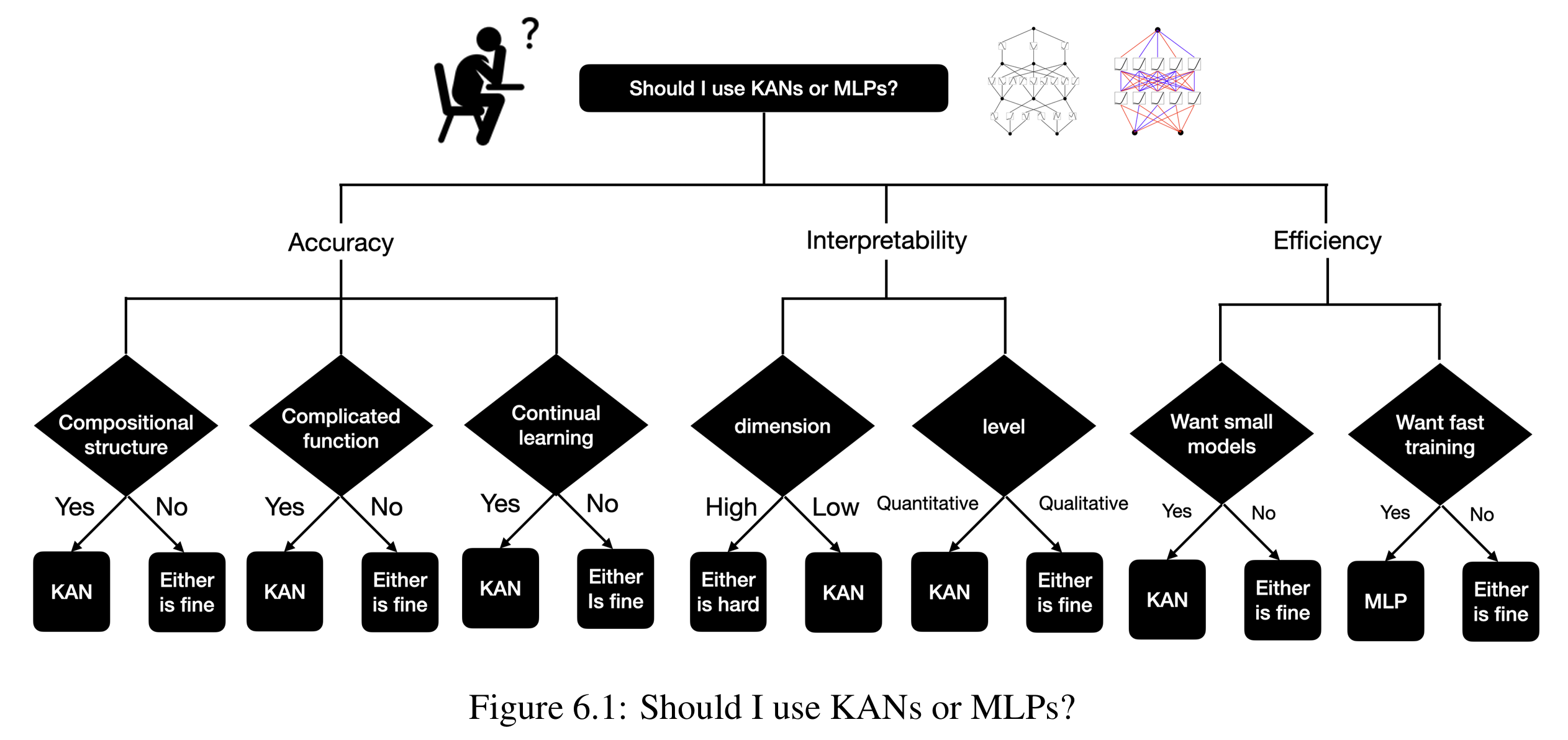

附上文章中的图:

【说明:本站主要是个人笔记和代码的分享,内容可能会不定期修改。目前文章支持直接转载,引用或转载请注明出处:https://www.guanjihuan.com 。本站采用知识共享署名许可协议 CC BY】